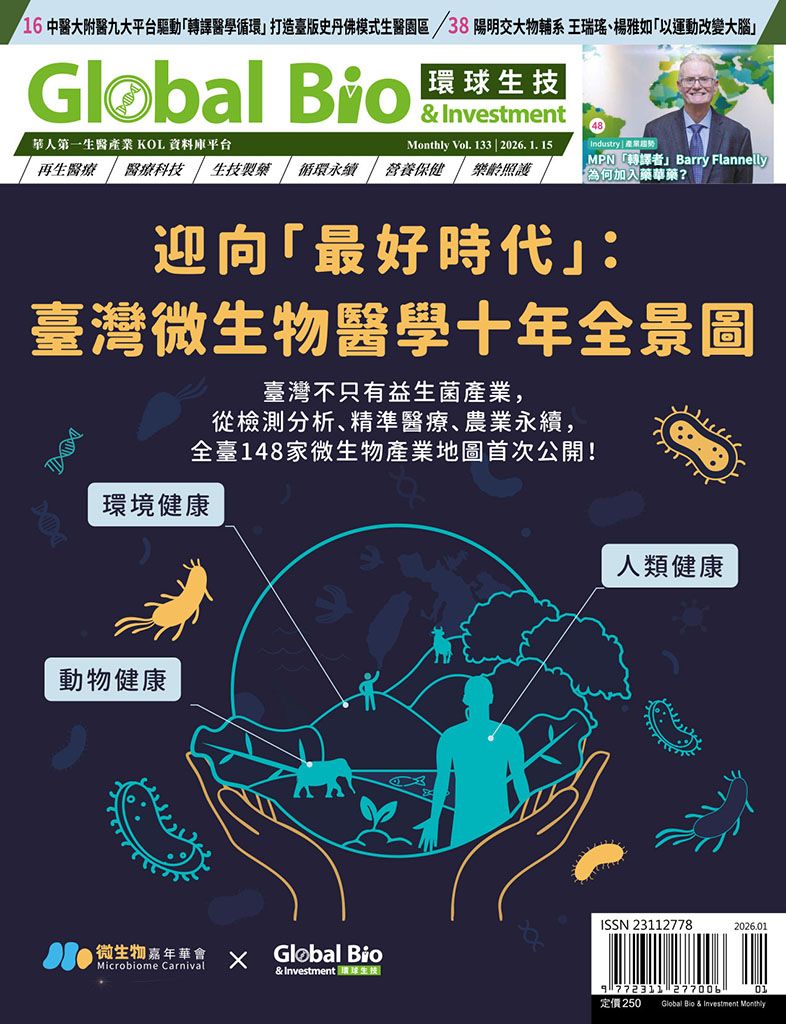

今年1月美國總統川普啟動星際之門計畫、中國大語言模型deepseek橫空出世,讓全球AI熱度再掀高峰。但近(4)日,歐盟執委會(EC)為確保AI的使用符合歐盟基本權利,避免可能對公民造成的傷害,頒布禁用指引,列出多種禁止AI介入的應用,其中包括生物特徵推測個人的種族、政治觀點等。資策會科技法律研究所分析師解析此次歐盟禁用類型,進一步觀察歐美中AI發展趨勢。

歐盟《AI法》列AI禁用指引 禁即時遠端生物辨識

去年8月,歐盟頒布《人工智慧法(AI Act)》,為全世界第一部針對AI實施的重要法律,並為該技術高風險應用制定相關規範,健康照護領域中被歸類於高風險應用的包括在醫療器材中應用AI技術、使用於生物特徵識別的AI、判定是否可獲取健康照護等服務的AI系統、任何形式的個人資料自動處理、出於醫療或安全原因的情緒識別等。

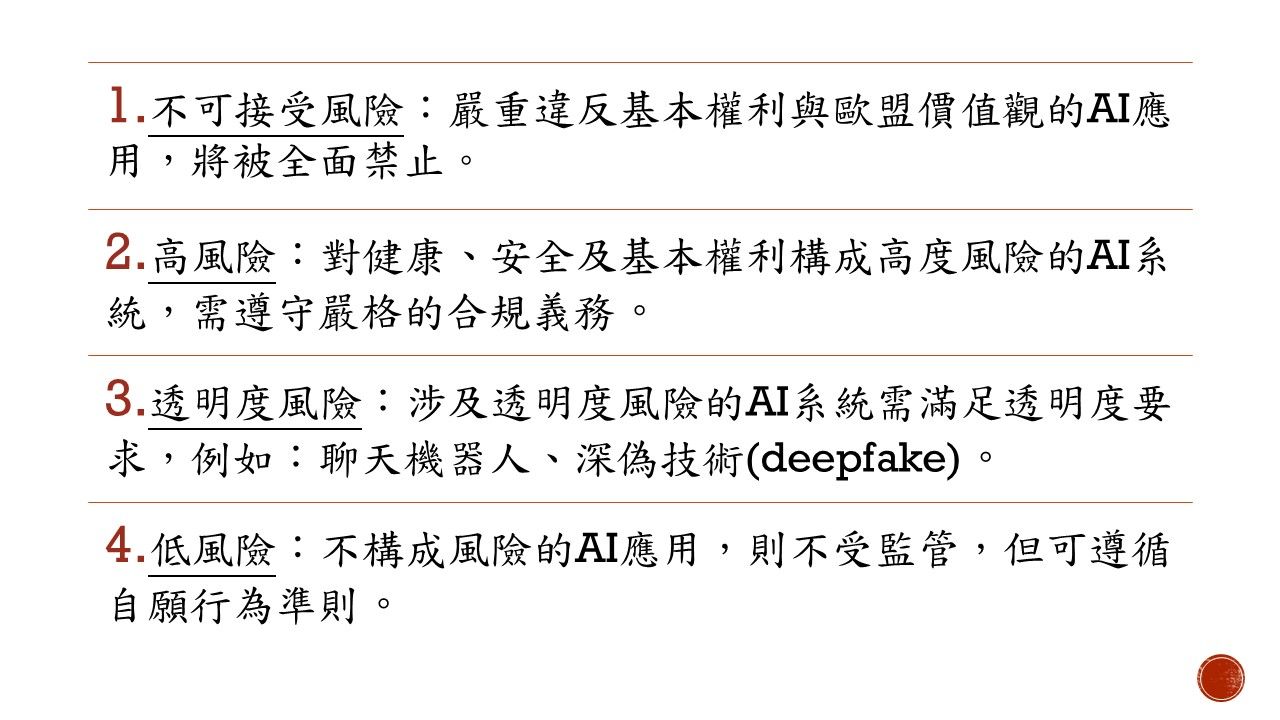

《人工智慧法》主要將AI系統劃分為4種風險類別,包括:不可接受風險(Unacceptable risk)、高風險、透明度風險(Transparency risk)、低風險(Minimal to no risk)。今年2月,歐盟基於《歐盟人工智慧法案》第5條,從「不可接受風險」中再框列出多種禁止AI介入的應用,包括:生物辨識、操縱行為、社會評分、犯罪風險預測等,並概述AI法案的監管機制、例外原則及未來發展趨勢。

《人工智慧法》將AI系統劃4種風險類別。(環球生技製圖)

資策會科法所表示,其中與生醫領域關的,包括:利用生物特徵推測個人的種族、政治觀點、宗教信仰、性取向等,並且禁止即時遠端生物辨識(real-time biometric identification, RBI),但不在此規範中的例外情形包括:搜尋嚴重犯罪受害者、預防即將發生的恐怖襲擊,搜尋某些特定犯罪的嫌疑人等。

另外,也禁止在工作場所或學校使用AI來識別情緒。但與醫療和安全用途相關則可除外。

其他禁止項目還包括:利用潛意識技術或欺騙性技術影響個人行為,剝削弱勢族群(如兒童、老年人或殘疾人士等),導致重大傷害;基於社會行為或個人特徵進行評分,並導致不公平對待;單純基於個人特徵評估犯罪風險,缺乏客觀證據支持;未經授權的面部資料抓取。

保守還是開放?歐美中AI監管態度大不同

資策會科法所提出,世界各國均積極發展AI技術,如美國總統川普於今年1月公布美國將啟動5,000億美元投入「星際之門計畫」建設AI基礎設施,中國亦於去年提出「人工智能+」行動並列為國家重要工作之一。

相較美中兩國快速發展,歐盟優先制定AI法,確實採取較為審慎的監管態度,其核心目標也是希望透過明確法律框架,確保 AI 的應用既合規又安全,同時促進技術發展的有效性與一致性。

資策會科法所觀測到,由於AI應用尚在起步階段,各國對其風險評估與監管框架仍在調整中。然而,從歐盟AI法內容可見,將AI應用於健康照護領域被歸類為高風險技術,後續各國如何將監管落實到實際應用,值得持續關注。